Das KI-Gesetz für Europa ist in Kraft

Ab 1. August ist ein Gesetz für künstliche Intelligenz (KI) in Europa in Kraft getreten. So soll es die Technologie voranbringen.

Foto: PantherMedia / mdisk2514@gmail.com

Inhaltsverzeichnis

Der AI Act soll den Einsatz und die Rechte von auf künstlicher Intelligenz beruhenden Diensten und Anwendungen reglementieren. Er soll im staatlichen Kontext sicherstellen, dass die Grundrechte, die Demokratie, die Rechtsstaatlichkeit und die ökologische Nachhaltigkeit vor möglichen Risiken des Einsatzes von KI geschützt werden, während gleichzeitig die Innovation gefördert und Europa zu einem Vorreiter in diesem Bereich gemacht wird. Die Vorschriften legen Verpflichtungen für künstliche Intelligenz fest, die sich nach den potenziellen Risiken und dem Ausmaß ihrer Auswirkungen richten.

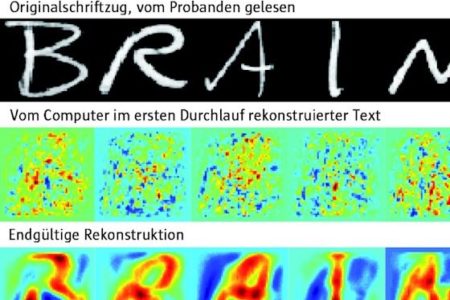

Das bedeutet in der Praxis, dass biometrische Kategorisierungssysteme, die sensible Merkmale verwenden (z. B. politische, religiöse oder philosophische Überzeugungen oder sexuelle Orientierung) ebenso wenig eingesetzt werden dürfen wie das generelle, ungezielte Auslesen von Gesichtsbildern aus dem Internet oder aus Videoüberwachungsanlagen zur Erstellung von Gesichtserkennungsdatenbanken.

Im Bereich der Arbeit und in sozialen Umfeldern darf keine Emotionserkennung durch KI sowie deren Auswertung verwendet werden. Zudem darf kein Social Scoring auf der Grundlage von Sozialverhalten oder persönlichen Merkmalen erstellt werden. Ebenfalls nicht zulässig sollen laut AI Act KI-Systeme sein, die das menschliche Verhalten manipulieren, um den freien Willen des Menschen zu umgehen, sowie Anwendungen, die eingesetzt werden, um die Schwächen von Menschen (aufgrund ihres Alters, einer Behinderung, ihrer sozialen oder wirtschaftlichen Lage) auszunutzen.

KI darf für Strafverfolgung genutzt werden

Doch im Rahmen der Strafverfolgung sieht der AI Act auch Ausnahmen vor. Die Verhandlungsführer einigten sich auf eine Reihe von Sicherheitsvorkehrungen und engen Ausnahmen für den Einsatz von RBI (Remote Biometric Identification: biometrische Fern-Identifizierungssysteme) in öffentlich zugänglichen Räumen zu Strafverfolgungszwecken, vorbehaltlich einer vorherigen richterlichen Genehmigung und für streng definierte Listen von Straftaten. Die „Post-RBI“ würde ausschließlich bei der gezielten Suche nach einer Person eingesetzt werden, die verurteilt wurde oder im Verdacht steht, eine schwere Straftat begangen zu haben.

Die „Echtzeit-RBI“, also die Nutzung biometrischer KI in einer Livesituation, würde strengen Bedingungen unterliegen und ihr Einsatz wäre zeitlich und örtlich begrenzt, und zwar für Zwecke wie die gezielte Suche nach Opfern von Verbrechen (Entführung, Menschenhandel, sexuelle Ausbeutung). Darüber hinaus wäre sie zur Abwehr einer konkreten und gegenwärtigen terroristischen Bedrohung oder für die Lokalisierung oder Identifizierung einer Person, die im Verdacht steht, eine der in der Verordnung genannten Straftaten begangen zu haben, zulässig.

Besondere KI-Regelungen im Hochrisikobereich

Für KI-Systeme, die als hochriskant eingestuft werden (aufgrund ihres erheblichen Schadenspotenzials für Gesundheit, Sicherheit, Grundrechte), gelten besondere Regelungen, zum Beispiel eine obligatorische Folgenabschätzung für die Grundrechte, die auch für den Versicherungs- und Bankensektor gilt. KI-Systeme, die zur Beeinflussung des Wahlergebnisses und des Wählerverhaltens eingesetzt werden, werden ebenfalls als hochriskant eingestuft. Die Bürgerinnen und Bürger haben das Recht, sich über KI-Systeme zu beschweren und Erklärungen zu Entscheidungen zu erhalten, die auf KI-Systemen mit hohem Risiko beruhen und ihre Rechte beeinträchtigen.

Zusätzlich sollen kleinere und mittelständische Unternehmen gefördert werden, sodass sie ohne unangemessenen Druck von Branchenriesen, die die Wertschöpfungskette kontrollieren, entwickeln können. Zu diesem Zweck fördert die Vereinbarung sogenannte regulatorische Sandkästen und Praxistests, die von nationalen Behörden eingerichtet werden, um innovative KI zu entwickeln und zu trainieren, bevor sie auf den Markt gebracht wird.

Die Nichteinhaltung der Vorschriften kann zu Geldbußen führen, die je nach Verstoß und Größe des Unternehmens zwischen 35 Mio. € oder 7 % des weltweiten Umsatzes und 7,5 Mio. € oder 1,5 % des Umsatzes liegen.

Unterschiedliche Reaktionen auf KI-Regelung

Der Branchenverband Bitkom betont, dass die KI-Regelung noch viele offene Fragen lässt: „Nach langem Kräfteringen gibt es mit dem AI Act nun zwar einen EU-weiten Regulierungsrahmen für künstliche Intelligenz, mit dem Inkrafttreten sind aber sowohl auf nationaler als auch auf europäischer Ebene noch viele Fragen ungeklärt“, sagt Bitkom-Präsident Ralf Wintergerst. Ob Deutschland und Europa zu Innovationsstandorten für künstliche Intelligenz oder zu Nachzüglern werden, hänge entscheidend von der weiteren Ausgestaltung und Umsetzung des AI Acts ab. Wintergerst mahnt: „Die Umsetzung darf nicht zur Hängepartie für Unternehmen werden: Lange Rechtsunsicherheit, unklare Zuständigkeiten und aufwendig bürokratische Prozesse in der Umsetzung des AI Act würden europäische KI-Innovation behindern.“ Ziel müsse sein, den Einsatz von KI sowohl in Wirtschaft und Verwaltung als auch in der Gesellschaft konsequent voranzubringen, was nur mit einer bürokratiearmen und praxisnahen Umsetzung gelingen könne.

„Es ist jetzt wichtig, die Umsetzung effizient und unbürokratisch zu gestalten“, sagt auch Joachim Bühler, Geschäftsführer des TÜV-Verbands. Eine einheitliche Interpretation und konsequente Anwendung des risikobasierten Ansatzes seien entscheidend, damit der AI Act in der Praxis wirksam wird – hier seien die Mitgliedstaaten gefordert.

EU-Kommission startet Konsultation

Wie die Umsetzung voranschreitet, will die EU-Kommission im Blick behalten und hat eine Konsultation zu einem Verhaltenskodex für Anbieter von KI-Systemen für allgemeine Anwendungen (General Purpose AI, GPAI) gestartet. Entsprechende Anbieter, die in der EU tätig sind, Unternehmen, Vertreter der Zivilgesellschaft, Rechteinhaber und akademische Experten, sind aufgefordert, ihre Ansichten und Erkenntnisse mitzuteilen. Diese sollen in die GPAI-Modelle einfließen. Interessierte Parteien sind ebenfalls aufgefordert, Beiträge zur Gewährleistung vertrauenswürdiger allgemeiner KI-Modelle in der EU zu leisten.

Erkenntnisse sollen in Bestimmungen einfließen

Darüber hinaus sollen die Rückmeldungen aus der Konsultation auch in die Arbeit des KI-Büros einfließen, das die Umsetzung und Durchsetzung der Vorschriften des AI-Act über GPAI überwachen wird. Das Büro entwickelt derzeit eine Vorlage und Leitlinien für die Zusammenfassung von Trainingsdaten, die zur Erstellung des GPAI-Modells verwendet werden. Die Vorlage und die Leitlinien werden von der Kommission angenommen werden und zu den weiteren Diskussionen über den Kodex beitragen. Bestimmungen über GPAI sollen am 1. August 2025, ein Jahr nach Inkrafttreten des KI-Gesetzes, zur Anwendung kommen.