Deepseek vs. ChatGPT: Was die chinesische KI anders macht

Deepseek hat die Tech-Welt erschüttert. Für angeblich einen Bruchteil der Entwicklungskosten soll der chinesische KI-Chatbot so gut sein wie ChatGPT, Gemini und Copilot. Dabei zeigt ein Blick auf die Technik, dass die Chinesen auch nur mit Wasser kochen.

Foto: picture alliance/REUTERS/Dado Ruvic/Illustration

Inhaltsverzeichnis

Deepseek hat einen fulminanten Auftritt hingelegt. Am 20. Januar veröffentlichte die chinesische Firma ihren ersten gleichnamigen Chatbot mit der Versionsnummer R1. Vier Tage und viele Medienberichte später brachen die Aktien führender US-Tech-Riesen ein. Nvidia, dessen Grafikprozessoren (GPUs) für das Training von KI benutzt werden, verlor so viel Marktwert wie noch nie ein Unternehmen in der Geschichte der Börse. Bei Google und Microsoft ging es an nur einem Tag um 4 % bis 6 % nach unten. Auslöser waren Berichte, wonach Deepseek den westlichen KI-Chatbots, allen voran ChatGPT, technisch überlegen sei und nur einen Bruchteil der Entwicklungskosten verschlungen habe, die etwa OpenAI habe investieren müssen. Doch was macht Deepseek anders?

Eine Frage der Technik

Zunächst ein paar Begriffsklärungen: Wenn man von KI redet, unterscheidet man meist zwischen dem Hersteller, dem KI-Modell im Hintergrund und dem Namen des öffentlich nutzbaren Chatbots – also etwa in dem Sinne, dass OpenAI mit dem aktuellen Modell GPT-4o den Chatbot ChatGPT betreibt. Bei Deepseek hat alles denselben Namen. Der Chatbot Deepseek benutzt das KI-Modell Deepseek R1 und wurde von der Firma Deepseek entwickelt.

Deepseek doch kein Schnäppchen?

Deepseek arbeitet bereits seit 2016 an dem KI-Modell. Das Unternehmen entstand aus dem Hedgefonds High-Flyer, der die KI für seine Trading-Geschäfte nutzen will. Bis zur Entwicklung von R1 vergingen also auch bei den Chinesen rund neun Jahre – kein ungewöhnlicher Wert. In Medienberichten hieß es oft, dass diese aber nur rund 5 Mio. $ dafür ausgegeben hätten, während die Entwicklung von ChatGPT mehr als 500 Mio. $ gekostet habe. Experten wie Sven Schmeier vom Deutschen Forschungszentrum für Künstliche Intelligenz (DFKI) bezweifeln das. Die genauen Kosten seien zwar nicht bekannt, wohl aber, dass Deepseek für das Training seiner KI 2048 Grafikeinheiten von Nvidia eingesetzt habe. „Eine davon kostet derzeit in Europa rund 30.000 $“, sagt Schmeier. Schon damit lägen die Kosten also bei rund 61 Mio. $.

Die in den Medien kursierenden 5 Mio. $ beziehen sich auf die Kosten eines einzelnen Trainingslaufes der KI. Wie viele Deepseek davon brauchte, ist nicht bekannt, wohl aber, dass insgesamt 2,7 Mio. Rechenstunden für das Training notwendig waren. „Deepseek ist kein kleines chinesisches Start-up“, sagt Schmeier. „Der realistische Preis für die KI dürfte nicht weit weg von dem sein, den etwa OpenAI gezahlt hat.“

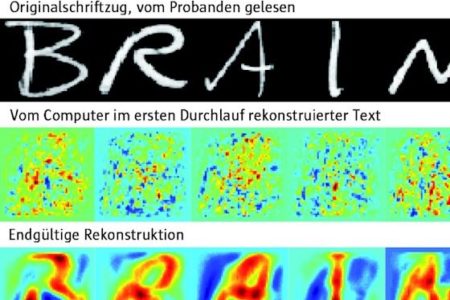

Das sind die Unterschiede zwischen Deepseek und ChatGPT

Die chinesische KI funktioniert grundlegend anders als etwa ChatGPT. Das US-Modell wurde mit riesigen Mengen an Textdaten gefüttert. Das Training sieht hier in etwa so aus, dass die KI Lückentexte vorgesetzt bekommt und dann erraten muss, welches Wort oder welche Wörter in die Lücke passen. Dazu bekommt sie einen Kontext von bis zu 1024 Wörtern davor und danach vorgesetzt. In einem zweiten Schritt des Trainings bewerten menschliche Tester die Antworten der KI und verfeinern sie somit. Das können Nutzer heute noch erleben, wenn ChatGPT sie manchmal fragt, welche von zwei generierten Antworten ihnen besser gefällt. Das Ergebnis ist ein riesiges Netz von Parametern. Das sind die kleinen Stellschrauben, mit denen eine KI ihre Antwort verfeinern kann. ChatGPT besitzt davon geschätzt 1,2 Billionen Parameter, Tendenz steigend.

Deepseek kommt mit rund 670 Mrd. Parametern aus. Das ist ebenfalls eine irrsinnig hohe Zahl, aber eben nur rund halb so viel wie bei der US-Konkurrenz. Das liegt daran, dass Deepseek ein anderes Modell benutzt. Es nennt sich „Mixture of Experts“, kurz MoE. Während ChatGPT bei einer Anfrage sein gesamtes Wissen einsetzt, besteht Deepseeks Modell aus bis zu 500 kleinen, spezialisierten Einheiten – also etwa aus einer Einheit für Matheaufgaben, einer für die Erstellung von Texten, einer, die auf Programmiercode spezialisiert ist, und so weiter.

Diesen Einheiten vorgeschaltet ist lediglich eine Ebene, die aus der jeweiligen Nutzeranfrage erschließt, welche Experten für die Beantwortung notwendig sind. Der Vorteil: Deepseek kann Anfragen so schneller bearbeiten und die jeweiligen Einheiten zielgenauer trainieren. Zudem haben die Chinesen das menschliche Feedback um einen Weg ergänzt, bei dem die KI ihre Antworten selbst bewerten kann und sich so ein Stück weit autonom verbessert. Wichtig dabei: Deepseek hat das MoE-Modell nicht erfunden, auch andere KI-Modelle nutzen es. Allerdings ist die chinesische KI der erste Open-Source-Chatbot dieser Größe, der es einsetzt.

Deepseek kann keine Bilder verarbeiten

Unter der Haube unterscheiden sich Deepseek und westliche Modelle wie ChatGPT, Gemini und Copilot also grundsätzlich. Nutzerinnen und Nutzer werden das jedoch kaum bemerken. „Es gibt auch für Chatbots Benchmarks“, sagt Schmeier, „aber die Unterschiede zwischen Deepseek und anderen Modellen sind da sehr gering.“ Ob die chinesische KI in einem bestimmten Bereich überlegen ist, sollten Nutzer nach Ansicht des Experten einfach selbst ausprobieren. Einen definitiven Vor- und Nachteil hat Deepseek aber: Das Modell R1 kann bisher noch keine Bilder verarbeiten, sondern nur Texte. Dafür ist es wesentlich günstiger als zum Beispiel ChatGPT. Dessen Premium-Abo kostet rund 23 € im Monat, bei Deepseek gibt es den gleichen Umfang bisher kostenlos.

Sind Sicherheitsbedenken berechtigt?

Mit der Veröffentlichung von Deepseek R1 wurden auch einige Sicherheitsbedenken geäußert. Eine Sorge betrifft den Datenschutz. Sämtliche von Nutzerinnen und Nutzern eingegebenen Daten werden schließlich auf chinesischen Servern verarbeitet. Zwar sichert sich Deepseek dabei nicht mehr Rechte zu, als es die US-Anbieter machen, manche Nutzer könnten aber trotzdem Angst haben, dass der chinesische Staat auf ihre Daten zugreifen könnte. Das lässt sich wohl kaum entkräften, aber: „Deepseek ist ein Open-Source-Modell“, erklärt Schmeier. „Jeder kann es also herunterladen und auf anderen Servern hosten.“ Der Experte glaubt, dass es nur eine Frage der Zeit ist, bis etwa US-Cloud-Dienste ihre Deepseek-Versionen anbieten. Theoretisch könnte das auch ein deutscher Anbieter machen – entsprechende Serverkapazitäten vorausgesetzt.

KI lässt sich auch umtrainieren

Darüber hinaus kam Deepseek schnell in Verruf, weil es bestimmte Informationen nicht preisgibt. So hat die KI etwa angeblich kein Wissen über das Tian’anmen-Massaker auf dem Platz des Himmlischen Friedens, bei dem 1989 das chinesische Militär Proteste blutig niederschlug und bis zu 2600 Menschen starben. Die chinesische Regierung leugnet das Massaker bis heute. Dass Deepseek diese Position übernimmt, findet Schmeier nicht so schlimm. „Jede KI hat Riegel, die von der jeweiligen Kultur geprägt sind“, sagt der Experte. Auch bei ChatGPT sind nicht alle Informationen verfügbar. Wer hier nach Anleitungen zum Bombenbau sucht, dürfte schwer enttäuscht sein – auch wenn er nie kriminelle Absichten hatte. Auch bei dem chinesischen KI-Modell gilt: Wer Deepseek auf eigenen Servern hostet, kann die KI auch umtrainieren und andere Riegel setzen.